Schlagwörter des Jahres: KI, Videoanalyse, Edge Computing und mehr

Dieser Beitrag wird von Albert Unterberger, Inhaber von Unterberger Consult mit umfangreicher Erfahrung in der Sicherheitsbranche, geschrieben. Lesen Sie mehr über Herrn Unterberger am Ende dieser Seite. Dieser Beitrag wird von Albert Unterberger, Inhaber von Unterberger Consult mit umfangreicher Erfahrung in der Sicherheitsbranche, geschrieben. Lesen Sie mehr über Herrn Unterberger am Ende dieser Seite. |

Per Definition handelt es sich bei einem „Schlagwort“ um „[…] ein Wort oder ein Ausdruck aus einem bestimmten Fachgebiet, das durch seine häufige Verwendung in Mode gekommen ist.“ Während Schlagwörter eine schlechte Presse bekommen können, weil sie überstrapaziert (und oft missbraucht) werden, werden sie in der Regel Teil unseres Wortschatzes, weil sie sich auf neue, aufregende Innovationen mit großem Potenzial beziehen.

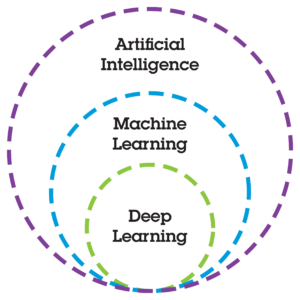

Die Schlagworte, auf die ich in diesem Beitrag eingehen werde – Artificial Intelligence (AI), Machine Learning, Deep Learning, Videoanalyse, das Internet der Dinge (IoT) und Edge Computing – haben alle ein enormes Potenzial an Sicherheit (und mehr). Ihre Anwendung wird in der Tat unerlässlich sein, wenn wir die Vorteile der kontinuierlichen Innovationen bei Video-Hard- und -Software voll ausschöpfen wollen.

Der Bedarf an Videoanalyse

Eine High-Level-Definition von Videoanalyse ist ziemlich einfach: Software, die automatisch Live- und aufgezeichnetes Videomaterial analysiert und Warnmeldungen, automatisierte Antworten und umsetzbare Erkenntnisse liefert.

Von der Videoanalyse sprechen wir seit Anfang der 2000er Jahre und sogar schon davor. Obwohl sie also keine neue Sache ist, wird ihr Wert erst nach und nach wirklich erkannt, da andere Technologien die ursprüngliche Vision einholen.

Der zunehmende Bedarf an Analytik ist offensichtlich. Mehr Kameras von höherer Qualität, die aus einer ebenso wachsenden Anzahl von Gründen in einer immer vielfältigeren Umgebung eingesetzt werden. Auf einer grundlegenden Ebene deutet dies auf eines hin: mehr Informationen, die überprüft werden müssen. Einer ganzen Menge weiterer Informationen!

Der Mensch allein kann diese Masse an Videomaterial, das von den Überwachungskameras weltweit erstellt wird, schlichtweg nicht überprüfen. Seine eigenen kognitiven Fähigkeiten – die zwar ausgezeichnet, aber nicht auf Hunderte oder Tausende von Kameras skalierbar sind – müssen durch Technologie unterstützt und ergänzt werden. Und das ist eine gute Sache. Computer haben die Möglichkeit, große Datenmengen in Echtzeit, 24 Stunden am Tag, mühelos zu verarbeiten.

Aber während die Verarbeitung von Daten eine Sache ist, erfordert die Fähigkeit, effektiv zu analysieren und nützliche Erkenntnisse zu liefern, ein hohes Maß an Wahrnehmung. Damit kommen wir zu einem der größten aktuellen Schlagworte, der künstlichen Intelligenz (KI; engl. Artificial Intelligence).

Können Computer menschliche Intelligenz reproduzieren?

Die kurze Antwort lautet: Nein. Die etwas ausführlichere Antwort lautet: Möglicherweise, aber derzeit noch nicht.

In Wirklichkeit ist „künstliche Intelligenz“ so etwas wie ein Missverständnis, oder zumindest allgemein missverstanden, da sie vorschlägt, künstlich menschliche Intelligenzstufen in einem Computer zu erzeugen. Aber um noch einmal auf eine Wörterbuchdefinition zurückzugreifen, ist Intelligenz einfach „die Fähigkeit, Kenntnisse und Fähigkeiten zu erwerben und anzuwenden“.

So gesehen ist es viel einfacher zu sehen, wie Computer künstlich intelligent werden können. Es ist auch einfacher zu verstehen, welche „Kenntnisse und Fähigkeiten“ erforderlich sind, damit die KI in der Videoanalyse effektiv eingesetzt werden kann (z.B. auf einer sehr einfachen Ebene, die Fähigkeit zu wissen, wann ein Objekt ein Mensch oder Tier oder nicht lebendiges Objekt ist).

Aber obwohl KI oft DAS Schlagzeilen-Thema ist, weist die Definition auf eine spezifischere Anforderung hin, damit KI Realität wird: die Fähigkeit von Computern zu lernen.

Den Maschinen beibringen, zu lernen…und zwar tief.

Computer zu trainieren, um zu lernen, ist das, was man (logischerweise!) als maschinelles Lernen (engl. Machine Learning) bezeichnet.

Wir alle sind regelmäßig dem maschinellen Lernen ausgesetzt. Für diejenigen von uns, die online einkaufen oder Filme auf dem Fernseher anschauen, basieren die Empfehlungen – und die mit der Zeit hoffentlich genauer und nützlicher werden – auf dem maschinellen Lernen. Es ist eine Sache, über unsere Präferenzen zu lernen, basierend auf dem, was wir gekauft oder gesehen haben. Das maschinelle Lernen wird jedoch richtig mächtig, wenn die Daten zusammen mit denen von Millionen anderer Menschen analysiert werden, die ähnliche Entscheidungen treffen und weitere bekannte demografische Informationen über uns hinzufügen (z.B. von Social Media Kanälen).

In der Welt der Videoüberwachung hat das maschinelle Lernen ein enormes Potenzial, wie ein Tweet des führenden KI-Experten Andrew Ng zeigt: „So ziemlich alles, was ein normaler Mensch in weniger als 1 Sekunde leisten kann, können wir jetzt mit KI automatisieren.“ Dazu gehört natürlich auch das Erkennen und Klassifizieren von Menschen (männlich, weiblich, Rasse, Alter), Tieren, Fahrzeugen und Gegenständen.

Wenn man Computer trainiert, um die Attribute jedes Objekts zu erlernen, wird die Videoanalyse immer leistungsfähiger. Aber zu verstehen, was etwas ist, ist eine Sache; zu analysieren, was es tut und warum, ist eine andere Herausforderung.

Die Videoanalyse war schon immer abhängig von der Phantasie, Erfahrung und den Fähigkeiten des menschlichen Softwareentwicklers. Und es ist einfach nicht möglich, dass ein Mensch einen Code für eine Videoanalysesoftware schreibt, die jedes mögliche Objekt in jeder möglichen Situation adressiert.

Was uns zum fortschrittlichsten Level der heutigen KI bringt, das Deep Learning.

Neuronale Netze und Objekteigenschaften

Im Mittelpunkt des Deep Learning steht der Einsatz künstlicher, neuronaler Netze: Strukturen für die Computerverarbeitung, die die Funktionsweise des menschlichen Geistes stärker nachbilden. Es ist wichtig zu verstehen, dass es nicht mehr um Algorithmen geht, sondern um die Trainingsdaten, die die Situationen beschreiben, die der Computer erkennen muss. Theoretisch gibt es also keinen limitierenden menschlichen Faktor mehr.

Ein sehr einfaches Szenario: Maschinelles Lernen wird Ihnen sagen, dass es Autos und Menschen gibt. Deep Learning wird Ihnen nicht nur sagen, welche Farbe die Autos haben und von welchem Hersteller, sondern auch Verkehrszeichen, Radfahrer, und sogar Menschen mit Handtaschen erkennen.

Wir können jedoch nur lernen, wenn wir das Material haben, aus dem wir lernen können. Computer sind nicht anders. Und während neuronale Netze es ermöglichen, Computer zu trainieren, ist die Menge der dafür benötigten Daten einfach enorm, wenn wir wirklich wollen, dass sie die Welt „lernen“.

Warum „Big Data“ eine Untertreibung war…

Für ein „tiefes Lernen“ in der Videoanalyse ist die Fähigkeit, diese Daten zu liefern, eine große Herausforderung. Filmmaterial von Videoüberwachungskameras ist oft sehr empfindlich und unterliegt zu Recht internationalen Datenschutzbestimmungen wie GDPR. Darüber hinaus ist die Rechenleistung, die für die Verarbeitung, Analyse und das Lernen benötigt wird, auch wenn große Datensätze gefunden werden können, von großer Bedeutung.

Für ein „tiefes Lernen“ in der Videoanalyse ist die Fähigkeit, diese Daten zu liefern, eine große Herausforderung. Filmmaterial von Videoüberwachungskameras ist oft sehr empfindlich und unterliegt zu Recht internationalen Datenschutzbestimmungen wie GDPR. Darüber hinaus ist die Rechenleistung, die für die Verarbeitung, Analyse und das Lernen benötigt wird, auch wenn große Datensätze gefunden werden können, von großer Bedeutung.

Aber wenn die Vergangenheit uns etwas sagt, dann, dass auch diese Herausforderungen überwunden werden. Und es gibt ein paar andere Schlagworte, die auf die potenziellen Mitwirkenden für die KI hinweisen: das Internet der Dinge und Edge Computing.

Das Internet der Dinge (IoT) ist für die Verbreitung von Daten von zentraler Bedeutung. Das IoT beschreibt die Gesamtheit der weltweit vernetzten Geräte – vom Handy bis zum Kühlschrank, von der Industriesonde bis zum Laternenmast, vom Sprachassistenten bis zur Netzwerk-Videokamera – und erzeugt jede Sekunde des Tages riesige Datenmengen. Viele dieser Daten haben einen potenziellen Wert, müssen aber übertragen, verarbeitet, bearbeitet, gespeichert und analysiert werden.

Das gängigste aktuelle Modell enthält alle Daten, die vom angeschlossenen Gerät an ein Rechenzentrum zur Speicherung und Analyse übertragen werden. Natürlich werden nicht alle Daten des Geräts nützlich oder wertvoll sein, so dass seine Übertragung und Speicherung erhebliche Ressourcenverluste in Bandbreite und Speicher mit den damit verbundenen Auswirkungen auf Energieverbrauch und -kosten verursacht.

Gehen wir noch zum Edge Computing. Wie der Name schon sagt, bringt Edge Computing mehr Rechenleistung an die „Kante“ des Netzwerks oder, konkreter ausgedrückt, innerhalb des angeschlossenen Gerätes selbst. Dies ermöglicht eine Datenanalyse durch das Gerät selbst – nach unserem Verständnis eine Netzwerk-Videokamera – und damit nur noch die Übertragung aussagekräftiger, nützlicher oder weiter zu analysierender Daten (z.B. Benachrichtigung von Beamten über Ausnahmen bei Grenzkontrollen, die eine Passkontrolle erfordern). Die Vorteile in Bezug auf Bandbreite und Speicherbedarf liegen auf der Hand, geschweige denn in der Steigerung der Effizienz im Betrieb.

Die Vision der Videoanalyse

Wir haben viel erreicht, und es lohnt sich, die Fäden zusammenzuziehen. Für die Zukunft der Videoanalytik geht es darum, die Leistungsfähigkeit von Computern und deren zunehmende Lern- und Verständnisfähigkeit mit den einzigartigen Entscheidungsfähigkeiten des Menschen zu verbinden. In vielerlei Hinsicht ist „Augmented Intelligence“ ein besserer Begriff als „künstliche Intelligenz“. Menschen, die durch Rechenleistung unterstützt werden, werden die Gewinner sein. Wir werden intelligentere Kameras sehen, die in der Lage sind, Situationen durch KI effektiv zu analysieren und den Bedienern die relevantesten Informationen zu liefern, um genaue, schnelle und effektive Entscheidungen über die richtige Reaktion zu treffen.

Sie können mehr darüber, was Axis für die nahe Zukunft hält, in diesem Beitrag zu den wichtigsten Branchentrends 2019 lesen.

| Albert Unterberger ist der Eigentümer von Unterberger Consult. Mit langjähriger Erfahrung in der Sicherheitsbranche als Spezialist für Videoüberwachung treibt er heute Strategien zur Entwicklung von Hightech-Videoprodukten und -lösungen sowie zur Positionierung von Produkten und Lösungen in vertikalen Marktsegmenten voran. Besuchen Sie http://www.unterberger-consult.com/aboutme/ für weitere Informationen. |